Lo use case mobility, sviluppato nell’ambito del progetto DYDAS, riguarda lo sviluppo E2E di un sistema di acquisizione dati attraverso analisi di flussi video in real time. Le immagini sono catturate da dispositivi IoT ed elaborate secondo paradigma edge computing attraverso hardware dedicato, installato sui dispositivi, e in grado di effettuare l’elaborazione di modelli di Machine Learning in real time, trasmettendo verso il datalake i soli risultati.

Reperimento di dati da analisi di immagini su dispositivi configurabili da remoto

Il sistema prevede l’installazione di dispositivi IoT su veicoli ed edifici per la raccolta delle immagini. I dispositivi operano individualmente sulla base dei modelli caricati attraverso un sistema remoto di gestione. I modelli di computer vision/machine learning vengono preaddestrati e quindi caricati nel dispositivo.

I modelli sono basati su TensorFlow, in particolare sono in formato TensorFlowLite.

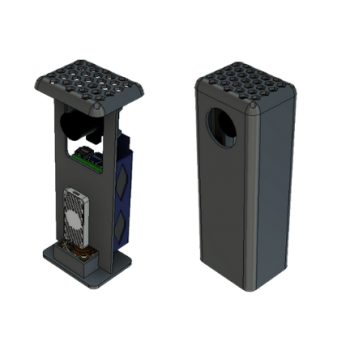

Dispositivi di edge computing

Il sistema, basato su Portainer, esteso attraverso un cli custom, permette di aggiornare in qualsiasi momento la destinazione d’uso di ogni dispositivo (modificando il modello da applicare al flusso video). Il sistema di gestione raccoglie attraverso l’HUB centrale i risultati e li mette a disposizione, tramite il Context Broker (CEF Context Broker), ai flussi ETL della piattaforma DYDAS.

I dispositivi gestiscono la computazione e l’elaborazione dei risultati mediante container docker governati da un sistema centralizzato di gestione.

I dispositivi non trasmettono immagini ma solamente i risultati delle analisi.

I dispositivi sono basati su un’architettura SOC (Raspberry Pi) ed integrano diversi sensori (tra cui la videocamera) e moduli (tra cui GPS ed LTE), e sono provvisti di un sistema operativo basato su Linux.